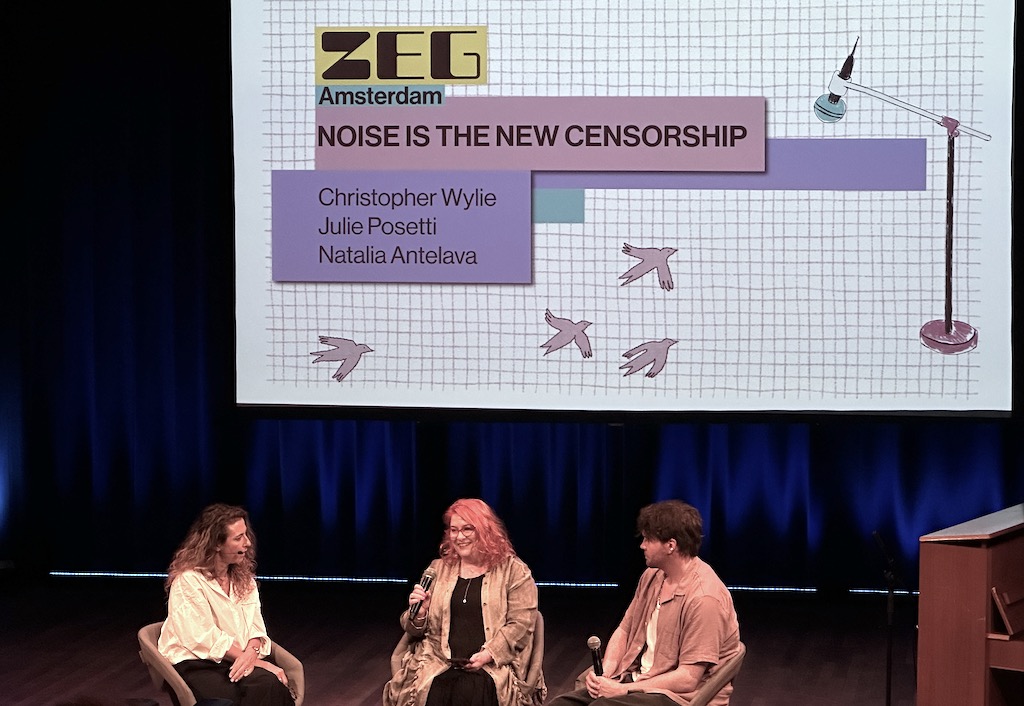

In un mondo ormai plasmato dagli algoritmi e dalle imprese paladine dell’intelligenza artificiale (ia), la questione di chi controlla la tecnologia è quanto mai urgente. In un dibattito organizzato durante l’evento ZEG Amsterdam, che si è svolto nel centro culturale De Balie, la studiosa e giornalista australiana Julie Posetti, il whistleblower canadese Christopher Wylie e la giornalista georgiana Natalia Antelava hanno concluso che il rischio non è rappresentato soltanto dall’eventuale guasto dell’ia, ma soprattutto il delirio di onnipotenza di chi l’ha ideata.

Wylie, diventato famoso per aver rivelato lo scandalo Cambridge Analytica, mette in guardia contro il fatto che una tecnologia in grado di sapere, vedere e prevedere tutto su di noi rischia di privare le persone della loro autonomia. “Provate a immaginare un futuro in cui tutto quel che vi circonda viene digerito da un’entità che vi osserva e riflette su di voi; in cui quell’entità può vedervi in qualsiasi momento ma voi non potete vederla, e prende decisioni per voi. Come potrete agire in quanto individui se il mondo sta letteralmente pensando a voi e reagendo contro di voi?”

L’effetto, sostiene l’esperto, è “intrinseco” oltre che strumentale: un’insidiosa infantilizzazione che “distrugge la vostra essenza in quanto persona”.

La setta dei tecnomessia

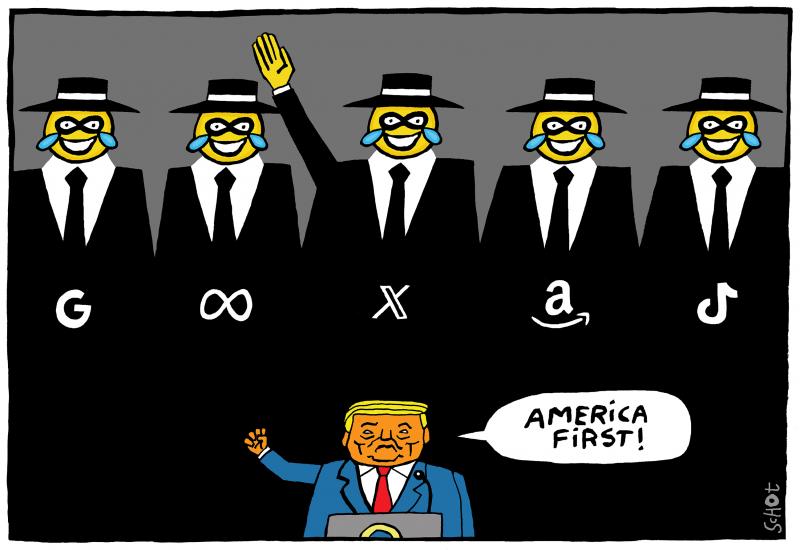

Wylie dipinge la Silicon Valley come una “setta” moderna, mossa da un’ideologia che unisce ambizione tecnologica e illusione messianica. Secondo lui, figure come Elon Musk (Tesla, X, SpaceX), Sam Altman (OpenAI) e Peter Thiel (PayPal), usano un linguaggio simile a quello religioso; parlano di creare “Dio attraverso i loro server” e immaginano un futuro transumanista in cui l’umanità “assume le caratteristiche del silicio” (da Silicon Valley): “immortale, onnisciente e senza alcun limite morale”.

Il data analyst canadese sostiene che non è tanto l’eccentricità dei “Tech Bros” a renderli pericolosi, quanto il potere di cui si sono dotati. I miliardari che credono di lavorare alla costruzione della prossima fase dell’evoluzione umana esercitano ormai una vera influenza politica, tanto nell’elaborazione delle leggi quanto all’interno delle democrazie in generale, senza alcun obbligazo di rispondere delle loro azioni. Posetti e Antelava sottolineano che l’incapacità dei mezzi d’informazione di prendere sul serio le loro idee, spesso liquidandole come stravaganti piuttosto che considerarle parte di un progetto politico radicale, ha permesso a questa “setta apocalittica” di operare indisturbata.

Wylie mette inoltre in discussione l’illusione della neutralità della tecnologia, descrivendo quest’ultima come intrinsecamente ideologica, fondata su presupposti capitalisti e individualisti occidentali che dividono, monetizzano e isolano gli utenti. Il risultato, aggiunge, è una forma di “colonialismo digitale”: se gli imperi ottocenteschi estraevano minerali, i colossi della tecnologia estraggono i dati e l’attenzione del pubblico, indebolendo le autorità locali e le strutture democratiche.

La vera resistenza, insiste Wylie, non comincia con la regolamentazione dell’attività delle “Big Tech”, ma consiste nell’evitare che la loro ideologia attecchisca.

I limiti dell’azione europea e la regolamentazione

Alla luce di questo Antelava affronta il tema della regolamentazione. Se la governance di internet negli Stati Uniti vacilla, l’Europa, osserva, è tra i pochi che tentano di fissare limiti e responsabilità alla tecnologia, mettendo in atto misure come la legge sull’intelligenza artificiale (AI Act), la legge sui servizi digitali (Digital Services Act, Dsa), e la leva fiscale. “I governi si sono svegliati” afferma, “ma non sarà troppo tardi?”.

Posetti sostiene questo approccio, in particolare laddove l’obiettivo è “garantire un certo grado di responsabilità” della tecnologia e permettere “la deliberazione democratica negli spazi pubblici del XXI secolo, tra cui anche gli spazi digitali”. Eppure, avverte “stiamo rincorrendo” le “Big Tech”, perché “non stiamo investendo nelle soluzioni come dovremmo”, e alcune di queste misure, come i requisiti di identificazione online per i minori di 16 anni, sono “piuttosto controintuitive”.

Gli ostacoli geopolitici, poi, sono a loro volta notevoli. I progressi sull’equità fiscale e sulla responsabilità delle piattaforme digitali, osserva Posetti, sono stati “bloccati e frenati dalla prepotenza assoluta di Donald Trump nella guerra dei dazi”. Lo squilibrio di potere “supera quello tra Davide e Golia... negli Usa c’è una vasta gamma di miliardari”, che sfruttano la loro influenza economica e diplomatica “per contrastare la regolamentazione europea”.

Affinché la regolamentazione funzioni, insiste Wylie, dev’essere strutturale e applicabile. “Non c’è nessuna regola di sicurezza per la tecnologia. Non ci sono standard. È assurdo, ma viviamo in un epoca in cui il tostapane che abbiamo in cucina deve sottostare a più norme di sicurezza che una piattaforma usata da un miliardo di persone”.

La soluzione richiede da un lato princìpi in materia di progettazione – il “prendersi un momento per fare un passo indietro e riflettere su quale ideologia di fondo adottare nella concezione e nel design” –; dall’altro il principio di responsabilità, ovvero “completare la regolamentazione con pene effettive, quindi con la responsabilità penale per i dirigenti che contribuiscono ad attività di natura criminale”. “Se Mark Zuckerberg temesse che la polizia federale venisse a bussare alla sua porta domani, risolverebbe subito questi problemi”, spiega.

Nessuno di questi problemi, sottolinea, può essere risolto solo a suon di codice: “La soluzione ai problemi politici è sempre politica, non tecnologica.In realtà non stiamo ancora parlando della verità scomoda, ovvero che questi sono adesso i leader politici della Silicon Valley, e vogliono indebolire le nostre società”. Conclude: “Non penso che queste imprese dovrebbero essere autorizzate ad esistere nella loro forma attuale”.

Riprendiamoci la democrazia

Per i tre intervenienti la posta in gioco sull’intelligenza artificiale non riguarda tanto la tecnologia, quanto la democrazia. Si tratta di stabilire chi definisce la verità e la capacità di agire e detiene il potere nel XXI secolo.Posetti sostiene la necessità di un nuovo multilateralismo, e di rinnovare gli accordi del Dopoguerra basati sui diritti umani.

Di fronte all’ascesa dell’autoritarismo e a “sistemi che soffocano la verità”, invoca “una sorta di nuovo approccio a una soluzione intergovernativa”, e si chiede “che tipo di risposta normativa possiamo dare, tutti insieme, al problema, oltre a quanto sta cercando di fare l’Unione europea”. Posetti evoca uno spirito simile a quello all’origine della creazione delle Nazioni Unite e del Consiglio d’Europa: “Queste istituzioni sono nate dalla catastrofe, per garantire la democrazia, lo stato di diritto e il rispetto dei diritti umani. Occorre ricostituire qualcosa di simile per affrontare l’era digitale, perché le normative nazionali da sole non ci stanno riuscendo”.

Wylie, da parte sua, invita a riprogettare la rete dalle basi, creando quello che chiama, in modo provocatorio, un “internet femminista”. “In questo momento non esiste una rete progettata per aiutarci, per renderci liberi, per rendere le nostre scelte più coscienti”. I metodi che dominano oggi “ci separano gli uni dagli altri... Non costruiscono affatto comunità”.

Ripensare l’intera rete significa focalizzarsi sugli utenti vulnerabili, sulle dinamiche e sugli abusi di potere, e progettarla in modo che abbia anche uno scopo sociale, non solo l’obiettivo di massimizzare i profitti.

Più di tutto, Wylie rifiuta la transazione che ha reso accettabile il danno: “Il prezzo della convenienza non devono essere i diritti umani. Una cosa non esclude l’altra”. Questo è il confine che l’Europa non dovrebbe superare. La regolamentazione non dev’essere solo un pezzo di carta, ma un vero azzeramento e ripensamento della sfera pubblica digitale, che comprenda chiari obblighi di diligenza, standard professionali per ingegneri del software, controlli di sicurezza obbligatori prima del rilascio, e responsabilità penale per le piattaforme all’origine di gravi danni.

Al momento l’Europa è un terreno di prova. L’IA Act, per quanto imperfetta, riafferma un principio che la Silicon Valley ha a lungo negato: la tecnologia dev’essere messa al servizio delle persone, non viceversa. Il fatto che questo principio resista (o meno) al potere dei nuovi oligarchi digitali sarà determinante non solo per il futuro dell’intelligenza artificiale, ma per il futuro della democrazia stessa.

Da che parte sta l’Europa?

Negli ultimi anni l’Unione europea ha istituito un quadro normativo digitale completo, che comprende la legge sui mercati digitali (Digital Markets Act, o Dma), il Digital Services Act, e quella sull’intelligenza artificiale in risposta alla minaccia proveniente dalla Silicon Valley sulle istituzioni, sulla politica e sulle abitudini.

Il Dma designa sei “gatekeeper” o guardiani del tempio (Alphabet/Google, Amazon, Apple, ByteDance/TikTok, Meta/Facebook, Instagram e WhatsApp, e Microsoft), a cui impone obblighi per prevenire il self-preferencing – per cui le imprese in posizione dominante favoriscono i propri prodotti e servizi sul mercato che dominano – e gli accordi di cartello.

“È assurdo, ma viviamo in un’epoca in cui il tostapane che abbiamo in cucina deve sottostare a più norme di sicurezza che una piattaforma usata da un miliardo di persone” – Christopher Wylie

Lo scorso aprile la commissione europea ha ritenuto che Apple e Meta stessero violando gli obblighi fissati dalla Dma sull’ “anti-steering” (la possibilità offerta gratuitamente ai produttori di app distribuite sull’Apple Store di segnalare agli utenti l’esistenza di altre piattaforme) e le pratiche di “app store tying” (vincolo commerciale che lega le applicazioni a un dato app store). Nel marzo 2024 la Commissione ha avviato procedimenti per inandempienza contro Alphabet, Apple e Meta.

Perché sono importanti questi casi? Gli obblighi della Dma sull’interoperabilità, le limitazioni sull’utilizzo dei dati e le norme “anti-steering” colpiscono direttamente la maniera in cui i gatekeeper possono integrare gli assistenti ia, raggruppare modelli nei sistemi operativi e utilizzare il tracciamento dati degli utenti per scopi di addestramento dell’intelligenza artificiale (procedimenti di definizione degli obblighi dell’ia). L’Ufficio europeo delle Unioni dei consumatori (Beuc), organizzazione chiave nella protezione dei consumatori europei, sostiene le decisioni della Commissione. Il Beuc ha accolto favorevolmente i procedimenti dello scorso aprile definendoli “necessari a dare più possibilità di scelta ai consumatori”.

D’altro canto, il Digital Services Act si applica ormai completamente alle principali piattaforme online (definite VLOP, nel linguaggio della Commissione), obbligandole a valutare e a ridurre i rischi sistemici, come la disinformazione algoritmica e i sistemi di suggerimento automatico legati all’ia. Nel marzo 2024, la Commissione ha pubblicato delle linee guida sulla mitigazione dei rischi per i processi elettorali e ha integrato il Codice di buone pratiche sulla disinformazione alla “Cassetta degli attrezzi” del Dsa, pubblicata lo scorso febbraio. I procedimenti legali in corso contro X e TikTok ai sensi del Dsa stanno verificando l’efficacia delle disposizioni sui rischi algoritmici.

Lo scorso gennaio inoltre, la vicepresidente della Commissione Henna Virkkunen ha sottolineato che “la responsabilità algoritmica e il controllo dei bias [settaggio dell’algoritmo] occupano una posizione centrale nel programma di applicazione del Dsa”. In linea con la vicepresidente, l’organizzazione-ombrello per i diritti digitali Edri mette in guardia contro “le narrazioni sulla semplificazione e la deregolamentazione” che potrebbero indebolire le normative europee.

La legge sull’ia (nota anche come Regolamento Ue 2024/1689) è entrata in vigore nell’agosto 2024, e fissa tre diversi termini per le aziende che utilizzano l’ia: in primo luogo, le pratiche a rischio inaccettabile sono vietate da febbraio 2025; in secondo luogo, gli obblighi per le ia generali vengono applicati da agosto 2025; infine, le normative europee sull’ia riguardo i sistemi ad alto rischio saranno applicate gradualmente entro la fine del 2026 o l’inizio del 2027.

Molto dipenderà dal lavoro del Consiglio europeo per l’ia recentemente istituito, che comprende rappresentanti delle autorità di controllo degli stati membri e un Ufficio per l’ia con sede a Bruxelles. Quest’ultimo coordina le autorità nazionali e supervisiona la conformità delle ia generali. Inoltre, supporta le politiche adottate e le azioni condotte dagli stati membri per trarre benefici sociali ed economici dall’utilizzo dell’intelligenza artificiale in Europa, condivide le migliori pratiche e offre la possibilità di sperimentare nel mondo reale e altre strutture europee di supporto per incentivare l’uso dell’ia.

Dopo aver interagito con il Consiglio europeo per l’ia e aver condotto una consultazione pubblica alla fine del 2024, la Commissione ha pubblicato il Codice di buone pratiche dell'ia generale per le imprese e le autorità, che sarà regolarmente aggiornato.

Un continente bloccato dalla dipendenza?

Queste risoluzioni saranno abbastanza efficaci da proteggere le attività, le istituzioni e i cittadini europei? “I ritardi nelle messa in atto, le consultazioni non vincolanti e l’eccessiva influenza del settore dell’industria potrebbero compromettere l’efficacia della legge sull’ia”, avverte l’Edri, ente europeo di controllo della privacy digitale. Un’altra organizzazione chiave per i diritti digitali, Access Now, ha sollecitato la Commissione a “mantenersi orientata al rispetto dei diritti umani ed evitare la trappola dell’industria”.

Dall’altro lato, le “Big Tech” stanno facendo lobbying pesante a livello europeo per influenzare il codice di buone pratiche dell'ia generale e le regole sulla trasparenza. I giganti della Silicon Valley sono avvantaggiati dal fatto che l’ecosistema dell’intelligenza artificiale in Europa dipende ancora quasi interamente da tecnologie straniere, lasciando all’Ue poca capacità di controllo sul modello e sul livello hardware della nascente economia dell’ia. Quasi tutti i modelli più avanzati usati sul continente, ChatGPT (OpenAI), Gemini (Google), Llama (Meta) e Claude (Anthropic), sono sviluppati e gestiti da imprese con sede negli Stati Uniti. Inoltre, questi modelli vengono addestrati tramite GPU NVIDIA ad alte prestazioni, prodotte da TSMC a Taiwan.

Non c’è da meravigliarsi se la corte dei conti europea nella sua Relazione speciale 12/2025 ha ammonito che l’Unione “è ancora lontana dal raggiungere l’autonomia nella produzione di microchip” e rischia di restare indietro rispetto agli Usa e all’Asia in materia di autosufficienza nei semiconduttori. Allo stesso modo, il rapporto del parlamento europeo “Rendere l’Europa un continente dell’ia”, pubblicato lo scorso settembre, mette in risalto l’attuale “dipendenza da paesi extraeuropei per le megafabbriche dell’intelligenza artificiale” e la necessità di investimenti coordinati nei data center e nelle competenze annesse.

In pratica, il modello è americano e la potenza di calcolo è taiwanese. Se l’Europa si concentra sulla regolamentazione trascurando la messa in atto rischia di rimanere un potere normativo senza alcuna sovranità tecnologica.

Tensioni crescenti con Washington

Mentre l’Ue continua ad avanzare con il Dsa e il Dma, crescono le tensioni tra i due partner transatlantici. Donald Trump ha minacciato di imporre nuovi dazi e rappresaglie contro i paesi che adottano “tasse sul digitale” o introducono leggi da lui ritenute discriminatorie nei confronti delle “Big Tech”.

Un dispaccio diplomatico trapelato il 4 agosto ha rivelato che le ambasciate statunitensi avevano ricevuto l’ordine di opporsi attivamente alla regolamentazione digitale europea. Questo ha spinto i legislatori europei a denunciare la campagna di Washington come attacco diretto alla sovranità dell’Unione.

Ma nonostante le pressioni Bruxelles rimane sulle sue posizioni. La Commissione ha avviato diverse inchieste ai sensi del Dsa, coinvolgendo X (ex Twitter) per i suoi algoritmi e la scarsa trasparenza e individuando in via preliminare delle violazioni da parte di TikTok e Meta. Queste ultime avevano negato ai ricercatori l’accesso ai dati e ostacolato la segnalazione dei contenuti. Ai sensi del Dma, Apple e Meta sono già state multate rispettivamente per 500 milioni e 200 milioni di euro.

Nel frattempo, la Francia e la Germania cercano di ridefinire l’equilibrio tra regolamentazione e competitività. Il Vertice sulla sovranità digitale co-organizzato dai due stati, che si è svolto a novembre a Berlino, intendeva promuovere un quadro normativo europeo “semplificato” per favorire l’innovazione – un tentativo di allineare l’autonomia digitale europea con le sue ambizioni economiche, guidando al tempo stesso l’Unione nelle sue crescenti tensioni politiche e commerciali con Washington.

| Dati sull’uso dell’intelligenza artificiale nell’Ue (2022-2025) |

| Nonostante le pressioni politiche, l’utilizzo dell’ia in Europa sta lentamente aumentando, pur restando limitato. Secondo l’Eurostat (Ufficio statistico dell’Unione europea), poco più dell’8 per cento delle imprese dei 27 stati membri con dieci o più dipendenti hanno ricorso all’ia nel 2023, salendo al 13,5 per cento nel 2024: un incremento del 5,5 per cento. Tra le grandi aziende, il 41,2 per cento ha integrato l’ia, mentre la percentuale di piccole e medie imprese si aggira tra l’11 e il 13 per cento. Per quanto riguarda il personale, i primi risultati dell’indagine europea sulle condizioni di lavoro 2024, condotta dall’Eurofound, mostrano che attualmente circa il 12 per cento degli europei usa l’ia generativa nel suo lavoro quotidiano, con variazioni nazionali che oscillano tra meno del 5 per cento e più del 20 per cento. L’opinione pubblica resta cautamente ottimista: un’indagine Eurobarometro condotta lo scorso febbraio ha rivelato che oltre il 60 per cento degli europei considera positivo l’uso dell’ia in ambito lavorativo, con oltre il 70 per cento che ritiene che possa incrementare la produttività. Tuttavia, uno schiacciante 84 per cento sottolinea l’importanza di gestire attentamente l’uso dell’ia per tutelare la privacy e la trasparenza. L’insieme di questi dati delineano il quadro di un continente curioso riguardo all’intelligenza artificiale, anche se ancora titubante, la cui economia digitale continua a dipendere da pochi fornitori digitali. |

🤝🤝 Questo articolo è stato realizzato nell'ambito del progetto PULSE, un'iniziativa europea a sostegno della collaborazione giornalistica internazionale, e in partenariato con De Balie. Hanno contribuito alla sua stesura György Folk (EUrologus/HVG, Ungheria), Elena Sánchez Nicolás (EUobserver) e Ana Somavilla (El Confidencial, Spagna).

📺 Guarda la conversazione completa tra Natalia Antelava, Julie Posetti e Christopher Wylie al De Balie.

📄 Vogliamo la tua opinione sul giornalismo europeo! Unisciti ai lettori e lettrici di tutta Europa che ci stanno aiutando a dare forma a un'informazione più connessa e transnazionale sugli affari europei.

O

Ti piace quello che facciamo?

Contribuisci a far vivere un giornalismo europeo e multilingue, in accesso libero e senza pubblicità. Il tuo dono, puntuale o regolare, garantisce l’indipendenza della nostra redazione. Grazie!